自己训练transformer需要准备哪些东西

自己训练transformer需要准备哪些东西

训练Transformer需要准备以下几个方面的东西:

语料库:语料库是训练Transformer所必须的,它可以是文本、语音、图像等形式的数据集。语料库越大,训练出来的Transformer模型效果可能越好。

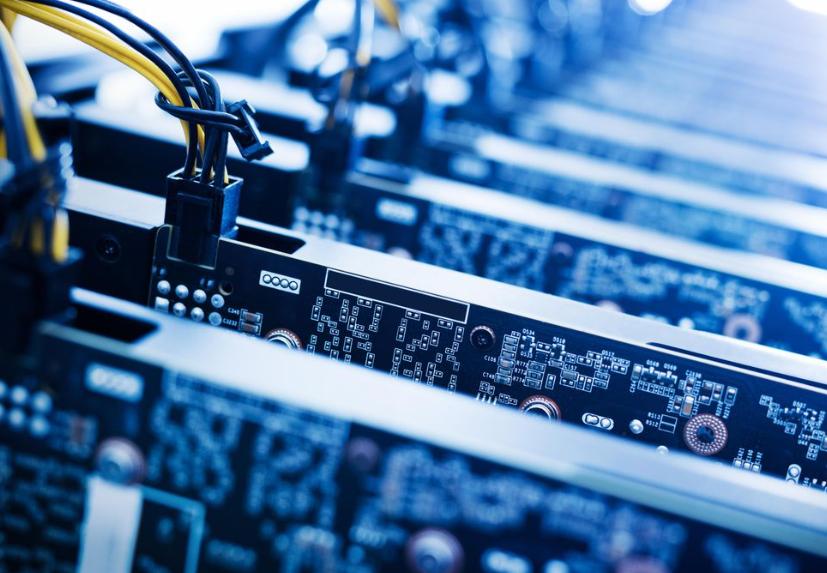

硬件设备:训练Transformer需要大量的计算资源,因此需要使用GPU或者TPU等硬件设备。可以使用云端服务,如AWS、Google Cloud等提供的云计算平台。

框架和库:训练Transformer的过程中需要使用深度学习框架和相关的库,如TensorFlow、PyTorch、Keras等。

数据预处理工具:语料库需要进行预处理,包括分词、编码、标记化等操作。可以使用开源的工具如NLTK、spaCy等。

模型架构:需要选择合适的模型架构,如Transformer、BERT、GPT等。可以选择已有的模型或者自己设计模型。

训练参数和超参数:需要选择合适的训练参数和超参数,如学习率、批大小、优化器、正则化等。

时间和资源:训练Transformer需要大量的时间和资源。需要根据实际情况来安排训练时间和资源,如GPU数量、训练轮数、迭代次数等。

暂无评论

发表评论